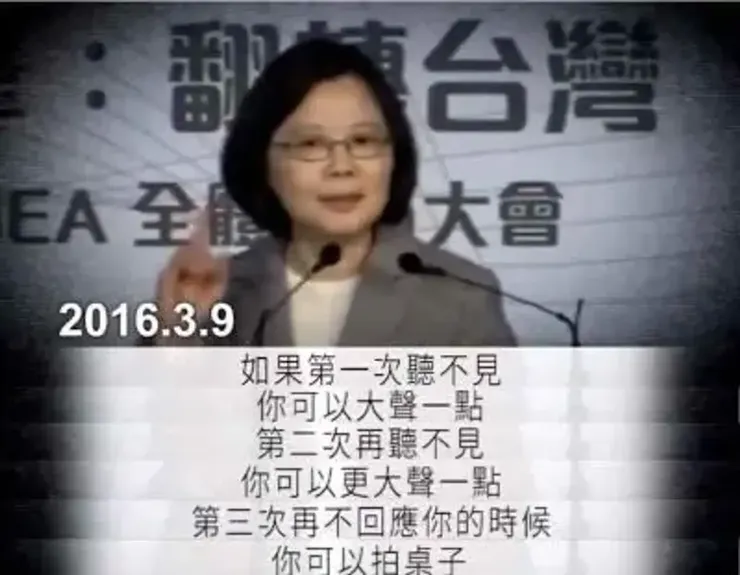

給不想看這篇文章的人一個總結圖:

研究指出,如果你想優化模型表現,有個非常簡單的方式:就是將問題講兩遍,甚至三遍以上。其核心邏輯如下:

1. 訓練機制限制:

由於 LLM 的訓練方式採用 Causal Masking,這導致 LLM 只能「由前向後看」Token,而無法回頭參考後面的資訊。然而如果你重複 Prompt 的情況下,其實你就是仿造了 BERT 的訓練模式,在 Bidirectional Attention 的狀況下去模擬雙向的方式來使用它。

2. 閱讀理解的挑戰:

以閱讀型的選擇題為例,若選項放在文章前面,當模型讀到後方的文章內容時,可能無法回頭確認前面選項的具體要求,進而影響回答品質。

針對這個問題,Google 團隊採取的對策非常簡單:直接在 Prompt(提示詞)中重複貼上一次問題。測試結果發現:

1. 非思考型模型(Non-reasoning Models):

在沒有內建思考過程或 Chain of Thought(CoT,思維鏈)的模型上,這種重複 Prompt 的方式展現了意料之外的卓越效果。

2. 思考型模型(Reasoning Models):

若模型本身具備 CoT 能力,或是在提示詞中加入「Think step by step」這類指令,重複問題的效果則與不重複基本一致,僅會微幅增加準確度(Accuracy)。作者在裡面講述說,為什麼思考型模型的效果並沒有很好?原因在於 Chain of Though 本身就帶有了重複閱讀的能力,所以並不會因為我們把 Prompt 重複,它就會再多讀幾遍。

論文也有提到,在什麼狀況下使用「重複 Prompt」會帶來很好的效益:

1. 處理不需要 AI 深度思考的問題:

例如從文章中找出答案、搜尋特定字眼等任務。在這些場景下,重複 Prompt 的效益會比處理思考型任務,或是使用思考型模型的效果還要好。

2. 輸入 Context Window 必須夠大:

如果視窗空間不足,重複幾次 Prompt 可能就會導致空間爆滿。

3. 實驗結果的差異:

最有趣的是作者特別提到,他們也有實驗過「不重複兩次,而是重複三次」的情況。在某些特定的模型或任務中,重複三次的效果反而才是最好的。

所以大家在嘗試時,如果發現重複兩次的效果不如預期,可以試著重複三次看看。