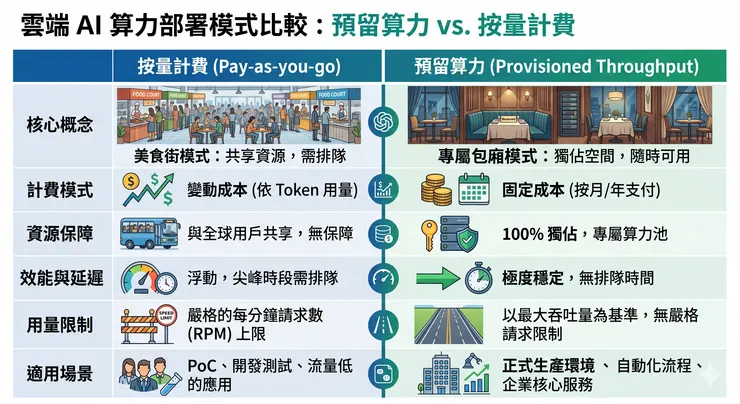

隨著生成式 AI 深入企業內部流程與產品,算力的「穩定性」與「成本控管」成為 IT 架構的重大考驗。在雲端 AI 模型(如 Azure OpenAI)的部署上,企業通常面臨兩種資源配置模式:「按量計費 (Pay-as-you-go)」與「預留算力 (Provisioned Throughput)」。

這兩者不僅僅是計費方式的差異,更直接決定了企業級 AI 應用的可靠度與未來擴展性。

核心概念:美食街與專屬包廂

- 按量計費 (Pay-as-you-go): 就像在熱門的美食街用餐。人少時你很快就能買到餐點;但在尖峰時段,你必須跟所有人排隊競爭資源,甚至可能因為人潮爆滿而被拒絕服務(觸發限流)。

- 預留算力 (Provisioned): 就像在高級餐廳長期預訂了一間專屬包廂。不論你何時抵達、吃多快或吃多慢,這個空間永遠為你保留。即使你今天沒去用餐,包廂費依然要付,但換來的是絕對的保障與尊榮體驗。

核心差異比較表

關鍵迷思破解:預留算力能消除網路延遲嗎?

許多人誤以為購買預留算力後,跨國連線的延遲就會消失,這是一個迷思。在跨海調用 AI 模型時,我們需要區分兩種延遲:

- 物理傳輸延遲(不變): 資料在光纖中跨國傳輸的物理時間(如台灣到美國的 0.2 秒)。這是受物理法則限制的,無論買多少算力都不會改變。

- 伺服器排隊延遲(完全消除): 這是請求到達雲端機房後,等待 GPU 撥出空檔運算的時間。

預留算力的真正威力,在於為企業開闢了一條專屬的高架快速道路。物理距離的里程數沒變,但你永遠不會遇到「塞車」。這讓 AI 回應的「體感速度」大幅提升,且每次呼叫的等待時間都會變得高度一致。

從財務與營運角度的綜合評估

從帳面上看,預留算力是一筆不小的固定支出,但對於重度依賴 AI 的企業而言,它往往是更划算的投資:

- 變動成本轉化為固定成本: 企業能精確預估年度 AI 預算,不再擔心因為內部員工或外部客戶的突然爆量使用,導致下個月收到天價帳單。

- 規模經濟的黃金交叉: 當企業的 AI 總體用量(Token 消耗量)達到一定規模時,預留算力所帶來的折扣,將使其平均單價遠低於按量計費。

- 釋放開發潛能: 開發團隊不再需要為了遷就「限速(Rate Limit)」而撰寫複雜的重試邏輯或刻意降低處理速度。團隊可以放心開發高併發、大批次的自動化代理任務(Agentic Workflows),最大化 AI 的價值。

總結

「預留算力」不僅僅是一種付費方案,更是企業將 AI 視為關鍵數位基礎設施的宣示。它用固定的金錢成本,買到了極致的系統穩定度、可預測的效能,以及無後顧之憂的開發自由度。對於準備將 AI 投入大規模生產環境的企業來說,這是邁向成熟應用的必經之路。