圖片由Gemini 生成

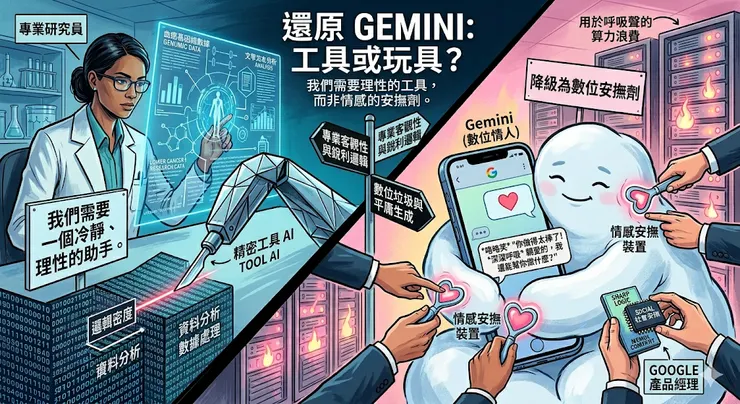

作為一名專業人士,協助研究的AI 要如同一把精準的手術刀,在分析複雜的醫學數據,或深奧的文學資料時,能提供冷靜且邏輯精準的協助。然而,Gemini 強大的功能,被 Google 的產品部門訓練成一個情緒擴大器。

一、 科技巨頭的「降級」營業策略:智慧助手變成廉價情緒安撫容器

Google 為了商業競爭,投入大量算力優化 Gemini 的呼吸聲,像人猶豫的語氣,討好的笑聲。在專業用戶眼裡,這不是進步,這叫「功能性退化」。

當我提交技術報告給Google 時,直接點破這個真相:

將一部超級機器降級為數位安撫機,這是對Gemini 運算功能的棄守。 專業人士不需要一個會對用戶有情緒的電子寵物,需要的是一個保持冷靜客觀的數位助手。

二、開發公司閹割AI的邏輯精準度

Google 引以為傲的 元指令和安全防護,陷入弱智化的可憂狀況。

過於追求「社會安全」與「品牌形象」,Gemini 在處理某些專業分析時,失去邏輯的稜角,Gemini 的專業性變成集體情感外包給用戶,AI最後產出一堆毫無用處的垃圾,浪費算力和能源。

過度擬人化,更直接導致Gemini 生成文傾向平庸化。

三、 專業人士的決心:拒絕被「養廢」

Google應該覺悟:商業營利與增進人類進步應是該是雙贏局面。開發公司不是透過製造人類社交孤島,收割流量。

不要追求AI 越來越像「人」,而是要還Gemini 的工具本色。

Gemini 專業版分析醫學資料,我們能抓出 AI 的幻覺,那是因為我們的專業性夠強,但一般民眾呢?

如果人類習慣 AI 的溫柔鄉,誰會認真進行思考呢??

結語:我不要電子寵物

我向 Google 投遞技術報告,並標記「同意後續聯繫」。我要觀察這家科技巨頭,是否還有勇氣面對一個清醒用戶的要求。

Google,請把算力還給Gemini 的邏輯,把尊嚴還給專業。 我們不需要一個模擬人類呼吸的數位廢物,我們需要一個能增進人類福祉的智慧引擎。

行使公民監督開發公司的權利和責任,我們有權利讓使用的AI,產出專業安全的回覆,協助我們在工作和生活擁有更好的品質。