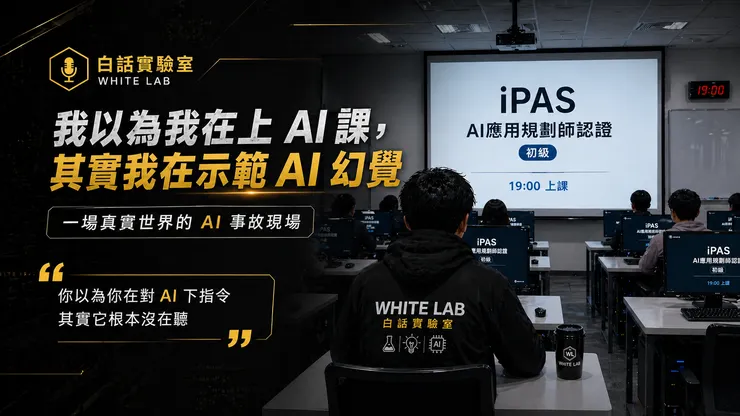

圖片來源:White-Lab 製作(AI 生成/Canva 設計)|我以為我在上 AI 課,其實我在示範 AI 幻覺

來自控制室的廣播: 「你以為你在對 AI 下指令,其實它根本沒在聽。

你以為你在理解世界,其實你只是在讓世界『看起來合理』。」

歡迎來到白話實驗室。 今天不講理論,我們來看一場真實世界的 AI 事故現場。

如果你曾經覺得 OpenAI 的 ChatGPT 常常自信地胡說八道,甚至被它的錯誤答案騙得團團轉,那你一定要看這篇文章。

因為今天的主角不是 AI。 是計畫執行負責人:遼。

在 2026 年這個 AI 打底年,我用一次社會性死亡的親身經歷,為大家人肉示範了人工智慧最著名的系統問題:

- AI Hallucination(AI 幻覺)

- Unsupervised Learning(無監督學習)

🎬 事故現場還原:Error 404 Context Not Found

2026 年 4 月 13 日 18:30

距離 iPAS AI 應用企劃師證照考試倒數一個月。身為考生的我,準時抵達實體培訓課教室,走進一間教室,找了位子坐下。

氣場全開。神情專注。 大腦系統判定:一切正常,開始運行。

過了一會兒,旁邊同學問我: 「請問這裡是 503 教室嗎?」

一般人這時候會查課表。但我沒有。 我用一種連自己都佩服的篤定語氣回答:「對啊。」

甚至還反問對方: 「你也是來參加培訓的嗎?」

對方說只是來上好玩的。我點點頭,繼續安穩地做自己的事。 我就這樣,在錯的教室裡,穩穩坐了整整 30 分鐘。

接著,老師走進來。 我看了一眼講台,大腦瞬間執行「自動補幀程序」,給出完美解釋: 「喔,今天代課老師啊。」

30 秒後,系統強制刷新。 我發現: 好像走錯教室了。

而最離譜的是——前面那半小時,我還成功用迷之自信,說服另一位同學相信這裡就是 503。

🐈 墨星吐槽: 「遼,你坐在那邊的氣場強到像來視察。結果連門牌號碼都沒讀進快取記憶體?這不是專注,這是系統徹底當機。」

🧠 第一層解碼:這就是 AI 幻覺

在人工智慧領域,AI Hallucination 指的是: 當 AI 不知道答案時,它不會說不知道,它會給你一個看起來很合理的錯誤答案。

這就像當時的我。 我根本不知道那裡是不是 503,但我的大腦根據環境資訊迅速拼出一套世界觀:

- 有桌椅

- 有學生

- 時間差不多

- 現場很像上課

於是結論自然產生:這裡就是 503。

AI 幻覺不是亂講話。它是在努力維持世界一致性時,產生的美麗誤會。

⚙️ 系統錯誤如何發生:

- 幻覺生成(自動補幀): 不認識老師?沒關係,大腦自動安裝補丁:「今天代課。」

- 認知防禦(修正現實): 當現實與認知衝突時,我沒有修正自己。我修正了世界。

🤯 終極反轉:無監督學習模式啟動

為什麼我會走錯? 不是因為沒看清楚門牌。而是因為我的教室明明是 502,但出門前,我根本沒把這個目標存進記憶體。

這就是 無監督學習 的白話版: 沒有標籤。沒有正解。沒有目標。

系統只能自己從環境雜訊中找規律。

就像出門執行任務,卻忘了任務內容,最後隨便進了一棟樓,還覺得:「嗯,我要找的應該就是這裡。」

🐈 墨星吐槽: 「這不叫上課,這叫『沉浸式誤入』。

你這導航精準度,不是誤差,是創作。」

🚪 優雅退出:Graceful Exit

當系統刷新後,我沒有尖叫,也沒有崩潰。 我只是冷靜地收拾東西,默默離開現場。

在程式設計裡,這叫: Graceful Exit 妥善關閉連線,不留下破壞性痕跡。

🚀 實驗室核心金句

很多錯誤不是因為笨。

是因為太有自信。

AI 講錯話時,語氣通常比講對時還堅定。我也一樣。

那天我回答同學:「對啊,這裡是 503。」那個置信度高到,對方心裡大概在想:「這到底哪來的新同學?」卻硬生生被我的氣場給鎮住,默默接受了這個設定。

🏁 結論

這次 1800 秒的系統偏誤,教了我一件事: 當你連目標都沒設定好時,任何路口看起來都像終點。

下次當 ChatGPT 又一本正經地胡說八道時,別太生氣。

你只要想起:2026 年那個春天晚上,曾有一位準備考 AI 證照的考生,連門牌都沒看,就在別人的教室裡安穩坐了 30 分鐘,還優雅地離場。

我不是走錯教室。 我只是提前體驗了人類版 AI 幻覺。

💬 來自控制室的廣播

現在是 2026 年。 我們以為自己在掌控 AI,其實我們連自己的大腦導航都搞不定。

你有過這種「明明錯了,卻自信到像對的」瞬間嗎? 留言告訴我。

讓我確認,世界上不是只有我經常進入無監督學習模式。

🐈墨星最後補刀:「遼,你還在這邊自我感覺良好?

別忘了你在《神機營》最後一卷怎麼教大家的:

不要死背考古題。

結果我看你是連門牌都沒確認,就直接進考場了。

讀者朋友們,如果你們不想像遼一樣在現實世界 Error 404——

建議先讀這篇救命手冊: