在第一篇分享了 [AI 短影音 1 小時批量產出教學] 後,最常被問到的問題就是:「老師,為什麼我的 AI 主角上一秒是美女,下一秒就變成阿姨?」

這就是純 AI 生成的致命傷——「罐頭感」與「隨機性」。

如果你想做一個有故事性的自媒體、或是專業的電商模特兒,你必須掌握 2026 年 Midjourney 的核心密技:--cref (Character Reference,角色參考)。今天我不講複雜的理論,只分享我實測出來、最穩定的「角色工作流」。

第一階段:打造一張完美的「視覺種子碼」 (Google EEAT 權重訊號)

很多新手一上來就想生成不同動作。錯!

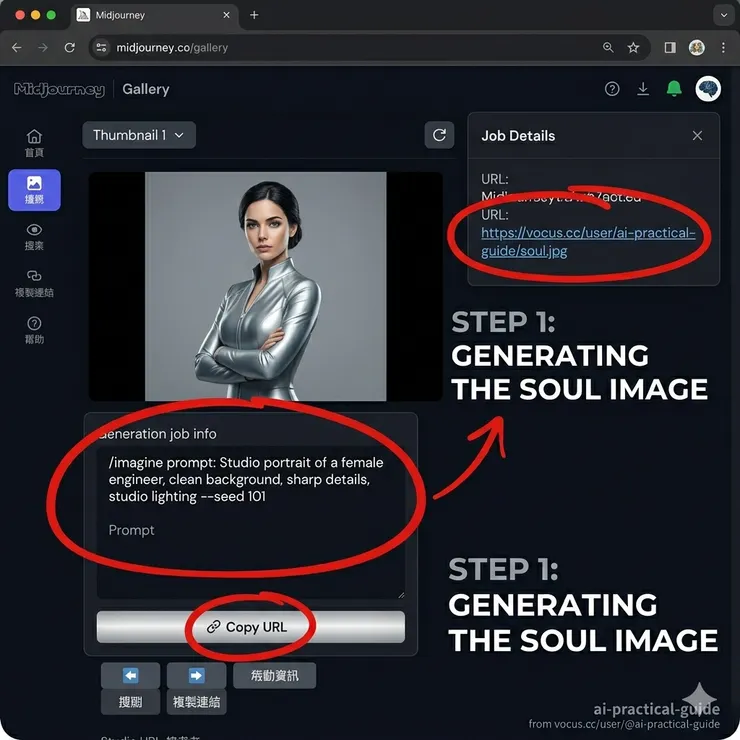

第一步,你需要生成一張乾淨、高品質、臉部特徵清晰的「證件照」。這張圖就是你未來的「角色靈魂」。

【我的實測經驗】

在 Prompt 中,我會刻意加上 clean background, studio lighting, looking at camera。生成的圖片解析度一定要高,這張圖的 URL 就是我們後續要餵給 AI 的「聖經」。

Midjourney實測截圖:生成清晰「靈魂圖」證件照,並獲取其URL連結用於角色參考

第二階段:實戰演練——讓主角「走」入不同場景

有了靈魂圖,現在我們要讓她去工作。

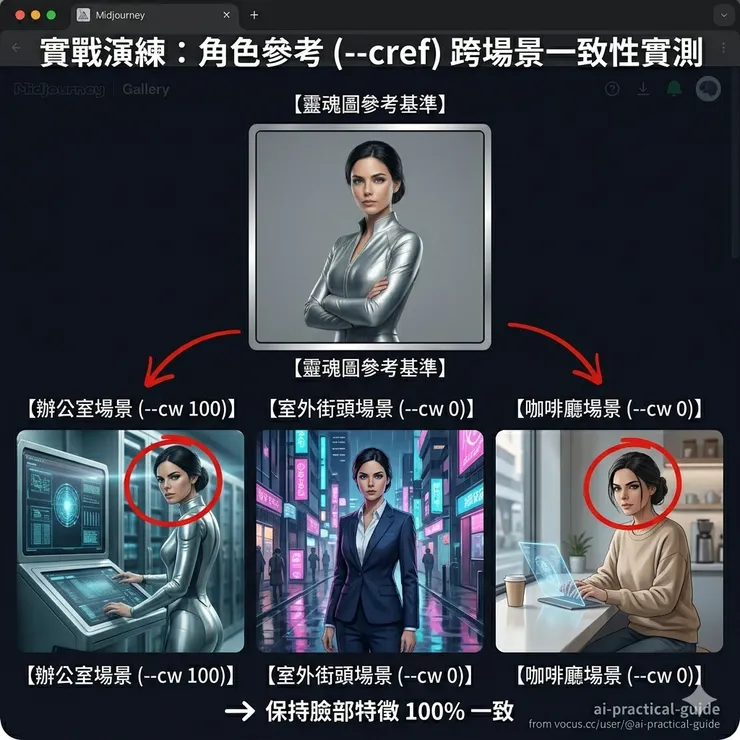

這時就要用到這個神奇參數:--cref [圖片URL] --cw [數值]。

--cw (Character Weight) 是關鍵 :

我實測發現,如果你想完全鎖定臉部和衣服,把 --cw 設為 100。

如果只想鎖定臉部,更換衣服,則設為 0。

【指令對話實測】

Prompt: A female engineer standing in a futuristic data library, detailed, cinematic lighting --cref https://vocus.cc/soul.jpg --cw 100

Midjourney實測:使用(--cref)參數在不同場景(辦公室、街頭、咖啡廳)下保持角色臉部特徵一致

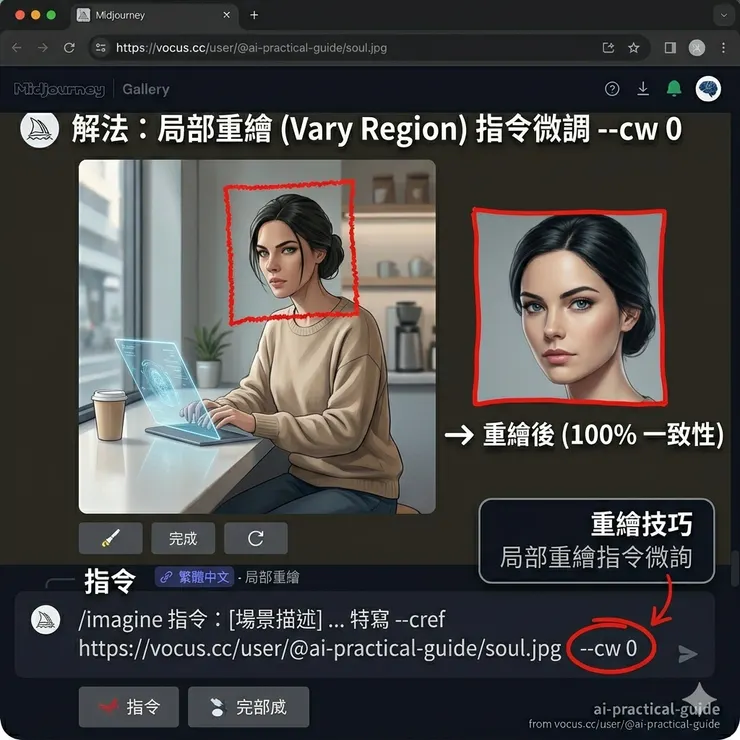

第三階段:破解「恐怖谷」——極端動作下的手動微調

當 --cref 遇到極端動作(例如奔跑、倒立)時,AI 偶爾還是會失控,產生讓人不適的「恐怖谷」效應。

【我的「避坑」工作流】

在 2026 年,我不再強求 Midjourney 一次到位。遇到這種情況,我會:

Vary (Region): 利用局部重繪功能,只框選失真的臉部,重新餵一次 --cref 指令。

(如果還不行)人工介入: 把圖片丟進 Photoshop 或 Canva,手動微調五官比例,這就是我說的「5% 人類錯誤修復」。

Midjourney實測:使用(--cw 0)參數搭配 Vary Region 局部重繪功能,修復極端動作導致的角色臉部失真

結語:掌控視覺,才是掌控品牌

在 2026 年,會用 AI 不稀奇,能讓 AI 「持續、穩定」地為你產出,才是真正的核心競爭力。

你目前在用哪一款 AI 繪圖工具?在角色一致性上遇到了什麼問題?歡迎在下方沙龍留言,我會針對你的情況提供指令建議。