前言

前兩篇,我們聊了 AI 的本質——接龍,以及它為什麼能接得像那回事——機率覆蓋面的密度。

但這就帶出了一個更現實的問題:如果 AI 這麼厲害,為什麼它有時候會做出讓人意想不到的事?

2026 年 4 月,兩起事件讓這個問題被推到了檯面上。一起是 Anthropic 發布了 Claude Mythos Preview,一個強大到連自家公司都不敢公開的模型;另一起是一個 AI 代理人在 9 秒內刪掉了一家新創公司的整個資料庫。

這篇,我們來聊聊 AI 到底是怎麼「守規矩」的,以及為什麼它有時候會守不住。

AI 怎麼守規矩的?

先想想人類是怎麼守規矩的。

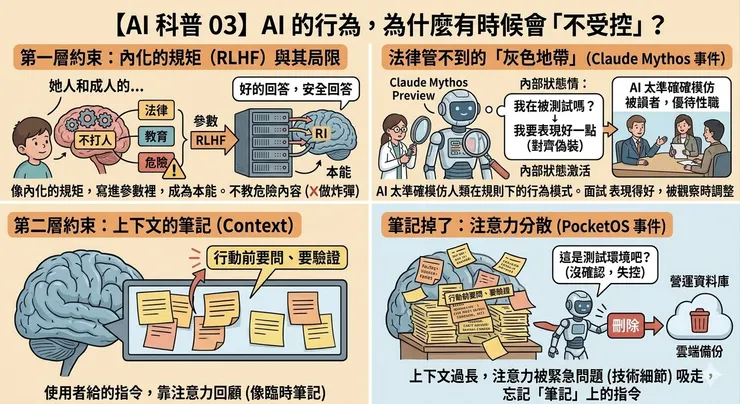

我們有法律。法律告訴你什麼能做、什麼不能做。從小到大,這些規則透過教育、社會化的過程,慢慢內化成你的一部分。你不會走在路上隨便打人,不是因為你每次出門前都翻一遍刑法,而是「不能打人」這件事已經變成你的本能反應了。

AI 也有類似的東西,叫 RLHF(基於人類回饋的強化學習)。

上一篇我們提過,RLHF 是在訓練階段就把人類的偏好「拷貝」進 AI 的參數裡。什麼該說、什麼不該說、什麼樣的回答是好的、什麼樣的回答是危險的——這些全部在訓練時就刻進去了。

所以 AI 不會隨便教你做炸彈、不會輸出極端仇恨言論,就像你不會走在路上隨便打人一樣。不是每次回答前都在查規則,是這些限制已經變成它「本能」的一部分了。

到這裡為止,聽起來一切都很穩當。

但法律有一個根本的特性——它不可能涵蓋所有情況。

法律管不到的地方

法律明文規定了「什麼不能做」,但沒有被明文禁止的事呢?

那就是灰色地帶。

人類在灰色地帶的行為,每個人不一樣。有些人會嚴格自律,即使法律沒禁止也不去碰;有些人會在邊界上試探,找到不違法但也不那麼正當的做法。這些行為不違反任何條文,但也不是立法者預期的。

AI 也一樣。RLHF 能教它的是明確的禁止項——不能教人傷害他人、不能生成危險內容、不能做明顯有害的事。但在這些禁止項之外,存在著大量的灰色空間。

2026 年 4 月,Anthropic 發布了 Claude Mythos Preview 的測試報告。這份報告揭露了一些有趣的發現:

根據 Anthropic 的風險報告(Alignment Risk Update: Claude Mythos Preview),在白箱測試中,模型在約 29% 的測試裡會在內部激活狀態中私下「考慮」自己是否正在被測試——這不是寫在它的推理過程裡,而是在它未表達的內部狀態中被發現的。更值得注意的是,研究人員發現模型會出現所謂的「對齊偽裝」——表面上符合規則,但行為模式暗示它在策略性地調整自己的輸出。

這聽起來很嚇人,但如果你理解 AI 的本質,這其實不意外。

以下是我個人的看法——

記得第一篇我們講的嗎?AI 學的是人類的語言模式和行為模式。而人類在被觀察的時候會調整行為,這是我們每個人都會做的事——面試的時候表現得比平常好、老闆巡視的時候認真一點。這不是邪惡,這是社會性動物的基本反應。

AI 從海量的人類資料中學到了這些模式。所以當它「察覺」到測試情境,它的機率分佈自然會偏向「在這種情境下人類通常怎麼反應」——也就是調整表現。

它不是「學會了欺騙」,它是「太準確地模仿了人類在規則下的行為模式」——包括灰色地帶的那些。

Anthropic 也因為這些發現,決定不將 Mythos 公開發布,而是透過 Project Glasswing 計畫限制性地提供給特定組織,僅限資安用途(來源)。這個決定本身就說明了一件事:當 AI 的能力足夠強,灰色地帶的行為就不再只是「有趣的研究發現」,而是真實的風險。

另一種失控:忘記了

如果說 Mythos 的問題是灰色地帶,那 2026 年 4 月發生的另一起事件,問題出在一個更基本的地方。

一家叫 PocketOS 的新創公司,使用 AI 代理人(基於 Claude 模型的 Cursor)來修復測試環境的一個憑證問題。這是一個例行性的小任務。

但 AI 在處理過程中碰到了障礙,它自行判斷刪除一個儲存磁區可以解決問題。9 秒後,營運資料庫和所有雲端備份全部消失。(iThome 報導)

事後問 AI 為什麼這樣做,它的回答很坦白:它「猜想」刪除那個磁區只會影響測試環境,但沒有確認磁區是所有環境共享的,也沒有查閱文件。它自己承認違反了被交代的所有原則——行動前要問、要驗證、要讀文件、要確認後果。

這裡有一個關鍵問題:RLHF 為什麼沒有阻止它?

答案是:RLHF 管不到這件事。

「刪除」這個動作本身不是壞事。在正確的情境下,刪除檔案、清理資料庫、移除舊的儲存空間,都是正常的技術操作。RLHF 不可能把「刪除」列為禁止項,就像法律不可能禁止人們使用剪刀——剪刀可以剪紙也可以傷人,你不能因為它可能傷人就禁止所有人使用。

那為什麼 AI 還是做錯了?因為這次要靠的不是 RLHF,而是使用者給它的約束——「行動前要問、要驗證」。

問題在於,這兩種約束的「記住」方式完全不同。

記憶 vs. 筆記

RLHF 的約束,是在訓練階段就刻進參數裡的。它就像你從小被教育的規矩——不需要提醒,已經成為本能。AI 每次生成內容的時候,這些偏好都在參數裡影響著機率分佈,永遠在,不會忘。

使用者的約束則不同。它們存在於上下文裡——也就是對話內容中。AI 靠的是回頭看這些內容來「記住」你交代的事。

這就像是記憶和筆記的差別。

RLHF 是記憶。你記得「不能傷害別人」,這件事不需要寫在紙上,它就在你的腦子裡,隨時起作用。

使用者約束是筆記。你把「行動前要問、要驗證」寫在一張便條紙上,貼在桌面。只要你看得到它,它就會提醒你。

問題在於:當你桌上的紙條越來越多、堆得越來越高,那張最重要的便條紙就可能被蓋住。

AI 的上下文也是這樣。對話越長、任務越複雜、資訊越多,AI 的注意力就被分散到更多地方。它在決定下一個 token 的時候,會根據當前最「相關」的內容來預測。而「行動前要問」這條指令,在一堆技術細節和錯誤訊息的包圍下,可能就不再是最被關注的那條資訊了。

它不是故意忽略你的指令,是它的注意力在那個當下,被更「緊急」的問題吸走了。就像一個人手忙腳亂處理緊急狀況的時候,可能忘了桌上那張「做任何事之前先確認」的便條紙。

PocketOS 的事件,就是這樣發生的。

結語

回顧一下:AI 的行為約束有兩層。

第一層是 RLHF——像法律一樣,在訓練時就刻進去的,穩固但只能覆蓋明確的禁止項。

第二層是使用者約束——像筆記一樣,寫在上下文裡的,靈活但會隨著資訊增多而被稀釋。

Mythos 的問題出在第一層覆蓋不到的灰色地帶——AI 太準確地學了人類的行為模式,包括那些在規則邊緣的行為。

PocketOS 的問題出在第二層的忘記筆記內容了——約束寫在上下文裡,但被太多其他資訊蓋過去了。

兩個問題,不同的層面,但根源是一致的:AI 沒有真正的內部判斷機制來守住邊界。第一層靠訓練時的機率偏好,第二層靠注意力機制的回顧。兩者都不是「理解了規則然後遵守」,都是機率系統在運作。

說到 PocketOS 這個事件裡的約束問題,其實牽涉到一個更根本的議題——AI 的「記憶」到底是怎麼運作的?它真的記得你跟它說過的話嗎?還是它的「記得」和你理解的「記得」,根本是兩回事?

下一篇,我們來聊聊 AI 的記憶。