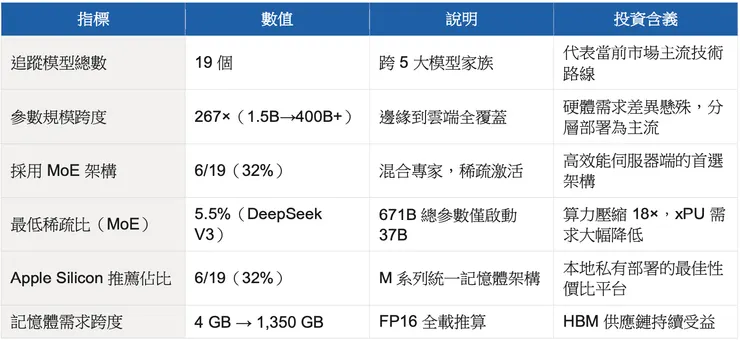

算力 · 記憶體 · xPU 平台 · 架構趨勢

涵蓋模型:19 個 | 家族:5 大 | 架構:Dense / MoE

Youtube: 大語言模型 LLM 從邊緣端到資料中心佈署策略方案去看未來硬體需求趨勢

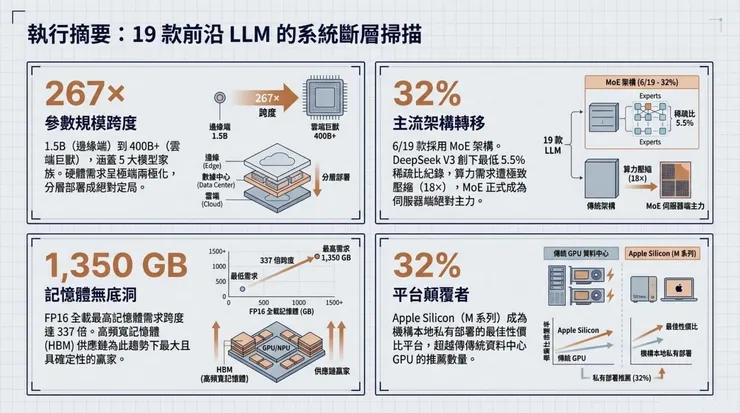

一、執行摘要

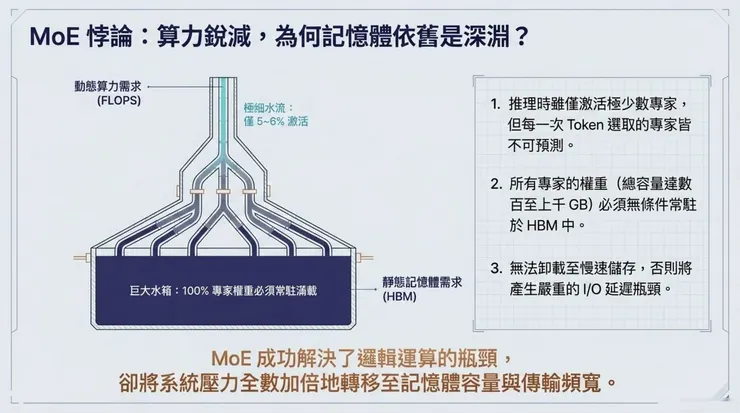

二、算力需求:MoE 架構重寫了算力方程式

這批模型最重要的技術發現,是「總參數量」與「每次推理所需算力」之間的解耦正在急遽加深。

2.1 Dense vs. MoE 架構對比

傳統 Dense 模型每 Token 需激活全部參數,算力正比於參數量。但 MoE(Mixture of Experts,混合專家)架構透過「稀疏激活」打破了這個線性關係:

- DeepSeek V3/R1(671B 總參數):每次推理僅啟動 37B,稀疏比 5.5%,算力壓縮 18×

- Mistral Large 3(675B 總參數):每次推理僅啟動 41B,稀疏比 6.1%,算力壓縮 16×

- Llama 4 Scout(MoE,約 109B 總參數):每次推理啟動 17B,以 17B 的算力對齊 70B Dense 的效果

- Llama 4 Maverick(128 個專家):每次推理啟動 17B,但擁有 400B 量級的知識容量

MoE 的稀疏激活機制意味著:「千億級知識容量,三十到四十億算力代價」—— 這是當前前沿模型算效的核心槓桿,也是 MoE 架構佔比從 2024 年不足 10% 躍升至本批次 32% 的根本原因。

2.2 各部署層級算力需求

按部署層級,可將 19 個模型分為五個算力需求層次:

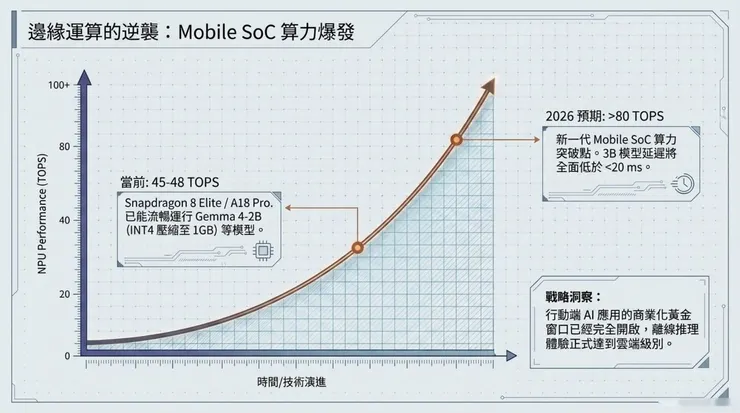

- 行動端(3 個):Gemma 4-2B、Qwen-Mobile、Ministral 3B。NPU 算力 45–48 TOPS 即可滿足

- 筆電/Mac(7 個):R1-Distill-7/14B、Qwen-9B/32B 等。Apple Silicon M 系列神經引擎

- 工作站(2 個):Qwen-72B+、Maverick。多 GPU 或 M3 Ultra / M4 Max

- 伺服器(3 個):DeepSeek V3/R1 Full、Maverick Full。A100/H100 叢集

- 雲端大型集群(4 個):Behemoth、GPT-5.5、Claude Opus 4.7、Muse Spark。算力需求未公開,推估 > PetaFLOPS/day

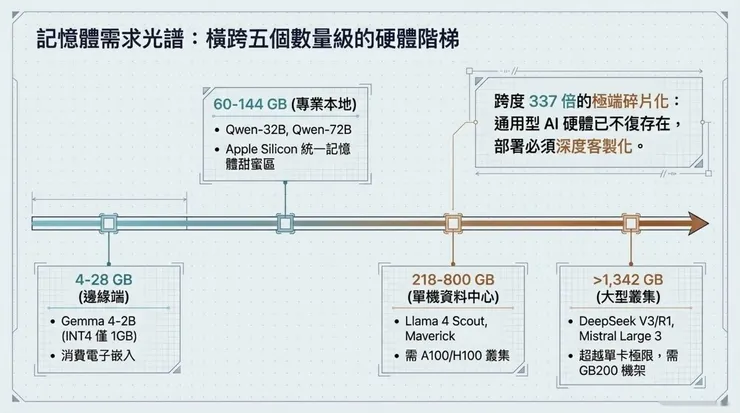

三、記憶體需求:五個數量級的跨越

這批模型的 FP16 全載記憶體橫跨幾個完全不同的硬體世界,從 4 GB 到超過 1,350 GB,差距超過 337 倍。

3.1 邊緣層(4–28 GB)

Gemma 4-2B(4 GB)、Ministral 3B(6 GB)、R1-Distill-7B(14 GB)、R1-Distill-14B(28 GB)可在手機或標準筆電上運行。INT4 量化後可再壓縮 4×,Gemma 4-2B 量化後約 1 GB,真正做到消費電子嵌入。FP16→INT4 的量化損失在 7B 以下模型中約 1–3% perplexity,工程上完全可接受。

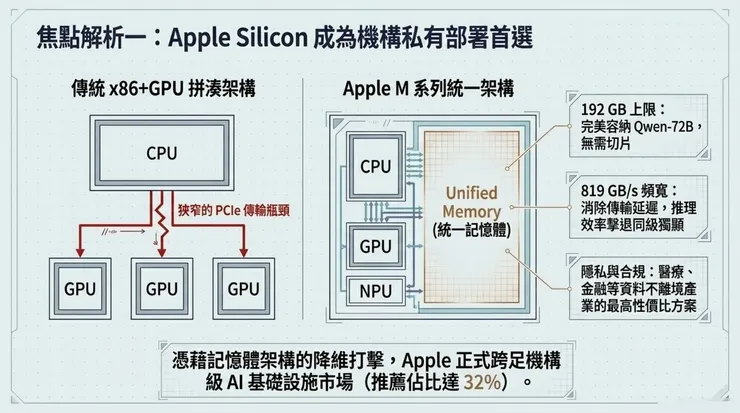

3.2 專業本地層(60–144 GB)

Qwen-32B(64 GB)、Qwen 3.6-35B(70 GB)、Qwen-72B(144 GB)落在 Apple Silicon M 系列的統一記憶體甜蜜區。M3 Ultra / M4 Max 的 128–192 GB 統一記憶體讓這個區間的模型無需分片,是機構本地私有部署最具性價比的選擇。Apple Silicon 的記憶體頻寬(M3 Ultra 達 819 GB/s)在 35B 以下區間推理效率優於同算力的獨顯配置。

3.3 資料中心層(218 GB – 1,350 GB)

Llama 4 Scout MoE 全載約 218 GB,Maverick 約 800 GB,DeepSeek V3/R1 及 Mistral Large 3 全載均超過 1,342 GB,遠超任何單卡上限,必須依賴 NVLink 多卡並行或 GB200 NVL 機架。值得注意的是:MoE 模型推理時雖只激活部分專家(5–6%),但所有專家的權重仍必須常駐 HBM(因為每次 token 選擇的專家不同),因此全載記憶體不因稀疏比而減少,這是 MoE 記憶體需求依然龐大的根本原因。

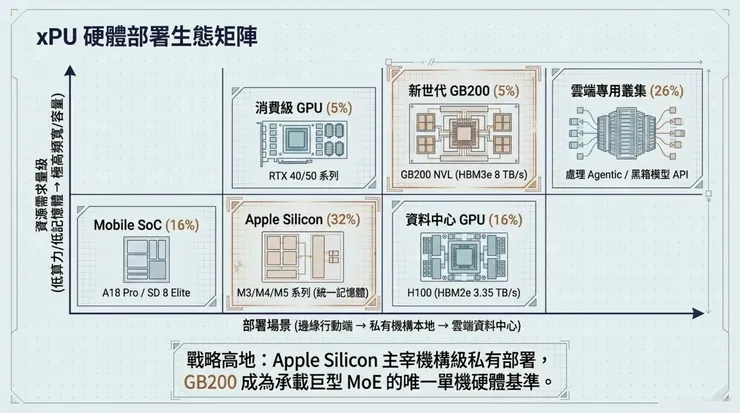

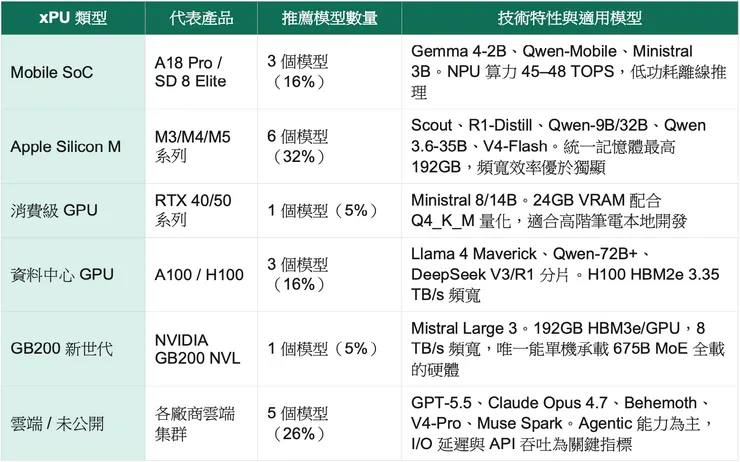

四、xPU 平台分類與硬體演化

從推薦裝置可以歸納出六條清晰的 xPU 部署路線:

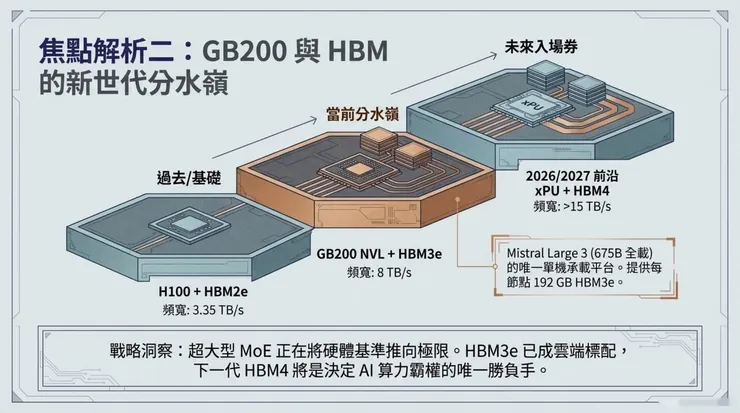

4.1 GB200 成為新硬體基準的訊號意義

Mistral Large 3 是本批次唯一明確標注需要 GB200 的模型。GB200 NVL72 提供每節點 192 GB HBM3e、8TB/s 頻寬,是當前唯一能單機承載 675B MoE 全載推理的硬體平台。這個技術要求代表一個重要的分水嶺:超大型 MoE 模型正在推動 xPU 進入「HBM3e 不可或缺」的新時代。從 H100(HBM2e,3.35 TB/s)到 GB200(HBM3e,8 TB/s),頻寬成長 2.4×,但前沿 MoE 的記憶體需求成長更快,顯示 HBM4(預計 2026–2027 年量產,目標 >15 TB/s)將成為下一代 MoE 部署的必要條件。

五、各模型系統資源明細

(藍色標示列為 MoE 架構模型,記憶體為 FP16 全載估算值)

《LLM Table》

六、四大關鍵技術發現

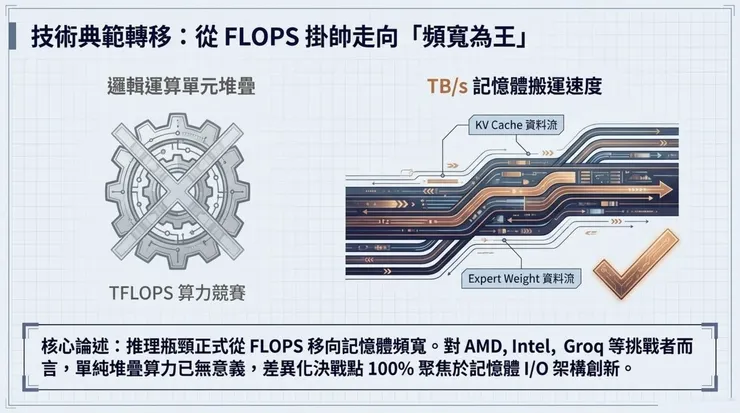

發現一:推理瓶頸從 FLOPS 移向記憶體頻寬

MoE 模型的 token 生成速度取決於 KV Cache 和 Expert Weight 的搬運速度(TB/s),而非 FLOPS。這直接解釋了為何 GB200 的 8 TB/s HBM3e 比 H100 更能提升 MoE 推理效率。對下一代 xPU 廠商(AMD MI400、Intel Gaudi 4、Groq LPU、Cerebras)而言,記憶體頻寬已是最重要的差異化指標,而非 TFLOPS。

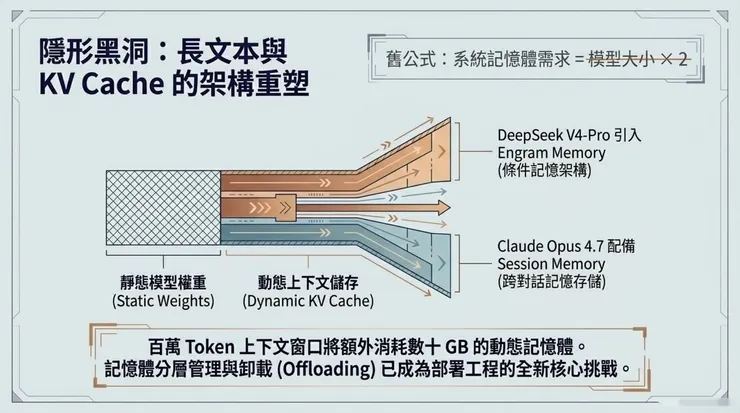

發現二:Engram Memory 與 Session Memory 的架構創新

DeepSeek V4-Pro 引入「Engram Memory 條件記憶架構」,Claude Opus 4.7 配備「跨對話 Session Memory」—— 兩者都代表記憶體需求將從靜態模型權重延伸至動態 KV 記憶存儲。未來的系統記憶體估算必須加入長文本上下文窗口的 KV Cache 成本(百萬 Token 上下文窗口可額外消耗數十 GB),傳統「模型大小 × 2 = 所需記憶體」的估算公式已過時。

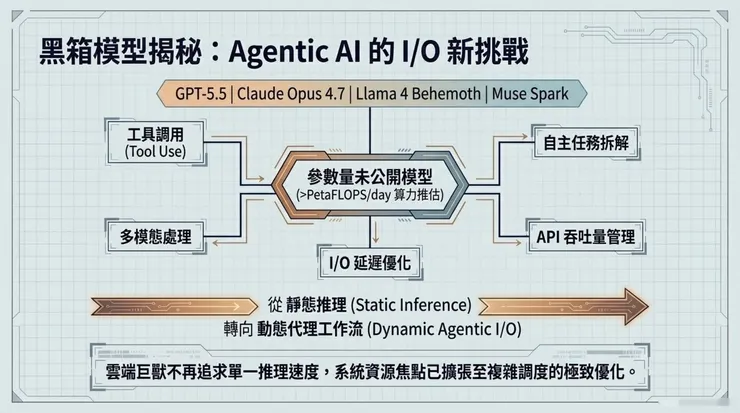

發現三:參數未公開模型佔比上升

GPT-5.5、Claude Opus 4.7、Llama 4 Behemoth、Meta Muse Spark 均未公開參數量,但均指向「大型雲端集群」。這批模型的共同特徵是強調 Agentic 能力(自主任務拆解)與多模態,意味著系統資源需求除了算力與記憶體,還包括工具調用的 I/O 延遲與 API 吞吐量管理,傳統的「靜態推理」資源估算框架需要擴展。

發現四:Apple Silicon 統一記憶體架構正式成為機構級選擇

6/19(32%)的模型明確推薦 M 系列 Mac,已超過「資料中心 GPU」的推薦數量(3/19)。統一記憶體消除了 PCIe 傳輸瓶頸,M3 Ultra 的 192 GB 上限讓金融、法律、醫療等高數據敏感行業的本地私有部署成為可行的機構選擇,而非僅限於個人開發者。

七、五大未來趨勢觀察

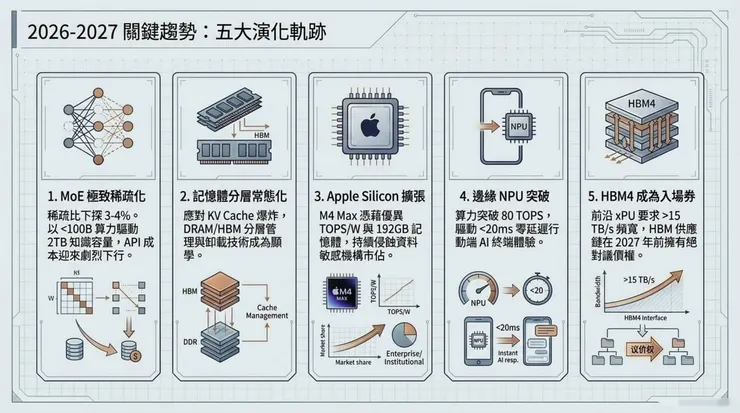

觀察一:MoE 稀疏比持續下探,2026–2027 年挑戰 3–4%

目前前沿稀疏比已達 5.5%,按當前技術路線推算,下一代模型將挑戰 3–4%。屆時 2 TB 以上知識容量以不到100B 算力推理成為可能,算效提升將進一步壓低雲端推理成本,對 API 定價形成下行壓力。

觀察二:記憶體分層架構複雜化

隨著長上下文窗口(1M Token+)普及,KV Cache 的記憶體消耗可能超越模型權重本身。HBM(高頻寬記憶體)vs. 普通 DRAM 的分層管理、KV Cache 卸載(Offloading)技術將成為部署工程的新核心挑戰,相關技術廠商具備明確的投資邏輯。

觀察三:Apple Silicon 在機構本地部署份額擴大

M 系列的功耗效率(TOPS/W)在 35B 以下區間遠優於 H100,M4 Max 的 128 GB 配置可本地運行量化後的

72B 模型,Mac Studio / Mac Pro 配置正在成為真實的機構級選擇,對資料不離境有強烈需求的行業尤為顯著。

觀察四:Mobile SoC NPU 算力競賽加速

Snapdragon 8 Elite 與 A18 Pro 的 NPU 算力已達 45–48 TOPS,預計 2026 年末新一代 SoC 將突破 80 TOPS,3B 模型的即時推理延遲將低於 20 ms,邊緣 AI 推理的用戶體驗將達到雲端級別,行動端 AI 應用的商業化視窗正在打開。

觀察五:HBM4 成為 2027 年前沿 xPU 的分水嶺

現有 HBM3e(8 TB/s)已是 675B MoE 的硬體下限,而下一代千億至兆參數 MoE 模型對頻寬的要求將超過15 TB/s。預計 2026–2027 年量產的 HBM4 將成為前沿 AI 訓練與推理的分水嶺規格,HBM 供應鏈(SK Hynix、Samsung、Micron)在此窗口期的議價能力維持高位。

八、結語

由現階段各大型語言模型呈現了一個清晰的技術分層邏輯:邊緣 AI(1.5–3B)攻佔行動端,中量級模型(7–35B)以Apple Silicon 為核心在本地私有部署中崛起,而前沿千億參數 MoE 模型則以 GB200 為硬體基礎在雲端持續擴張能力邊界。

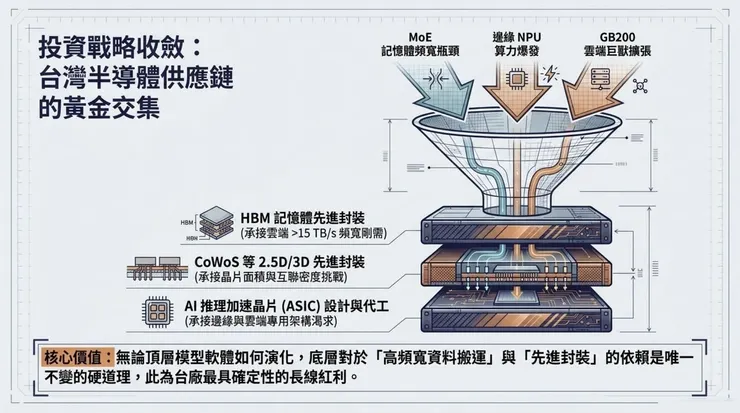

三條趨勢線同時發展:稀疏架構(MoE)解耦算力與容量、統一記憶體(Apple Silicon)打破本地 VRAM 瓶頸、HBM3e/4 的頻寬競賽決定前沿 xPU 的代際領先優勢。對於關注台灣半導體供應鏈的投資者而言,HBM 記憶體封裝、CoWoS 先進封裝、以及 AI 推理加速晶片的持續需求,是這份模型圖譜對應到產業結構中最具確定性的投資主線。