緒論:在無常變易中,為未來世代升起慈悲之誓願

南無阿彌陀佛。

懷著至誠的謙卑與感恩之心,貧尼在此呈獻這份研究報告。聯合國兒童基金會(UNICEF)的《2024年世界兒童狀況》報告,不僅是一份數據的彙編,更是一部揭示人類「共業」軌跡的現代「懸記」。它以科學的語言,預示了我們當下的集體抉擇,將如何塑造2050年無數未來佛子的生存情境。本報告的核心關懷,正是在前沿科技——特別是人工智能(AI)與神經科技——的浪潮以前所未有的深度與廣度席捲而來之際,我們應如何守護兒童最纖細、最可塑的心識(mind),確保他們的認知自由、內心隱私與精神世界的健全完整,不致淪為數據與算法的殖民地。本報告的目標,便是融合佛教唯識宗的智慧、現代發展心理學的洞見、以及國際人權法的堅實框架,為實現報告中所描繪的「加速發展」情境——亦即我們所祈願的「人間淨土」——擘劃一條清晰、慈悲且可行的倫理治理路徑。南無阿彌陀佛。--------------------------------------------------------------------------------

第一部:共業之緣起——宏觀趨勢下的前沿科技挑戰

1.1 帝網重重:三大趨勢交織下的兒童處境

在深入探討前沿科技的具體風險之前,我們必須先將其置於一個更為宏大的全球背景下進行考察。科技的發展並非孤立現象,而是與人類社會整體的變遷緊密相連。

根據《2024年世界兒童狀況》報告,三大宏觀趨勢正共同塑造著兒童的未來:「人口結構轉型」、「氣候與環境危機」以及「前沿科技」的突破。若以華嚴宗「帝網珠」(Indra's Net)為喻,這三大趨勢便如同網上無盡的寶珠,每一顆都映現著其他所有寶珠的光影,彼此互為因果、重重交織。

- 人口結構轉型與數位鴻溝:報告預測,未來的兒童人口將高度集中於非洲與南亞。例如,非洲兒童人口的激增,雖蘊含著巨大的「人口紅利」潛力,但也同時加劇了「數位鴻溝」的挑戰。在一個日益依賴數位技能的時代,若這些地區的兒童無法獲得平等的網路接入與數位教育,他們將在起跑線上被拋棄,人口優勢反而可能成為社會動盪的根源。

- 氣候危機與科技脆弱性:氣候危機已不再是未來的威脅。報告指出,氣候變遷引發的洪水與風暴,近年平均每日導致約兩萬名兒童流離失所。這些因災害而失去家園、學業中斷、遭受心理創傷的兒童,在面對網路剝削、不實資訊與算法操縱等科技風險時,其心理防線無疑變得更加脆弱。

若無視此種深刻的關聯性,任何單獨制定的科技治理政策,都將是片面且無力的。我們必須以一個整體的、系統性的視野,來應對這個由多重因素共同構成的複雜挑戰。

1.2 未來的岔路口:三種情境的因果法則

UNICEF的報告並未給出一個確定的未來,而是提出了三種基於我們當下集體選擇而可能展開的情境。這三條路徑,清晰地揭示了因果法則的運作:我們今日播下的種子,將決定兒童在2050年收穫的果實。

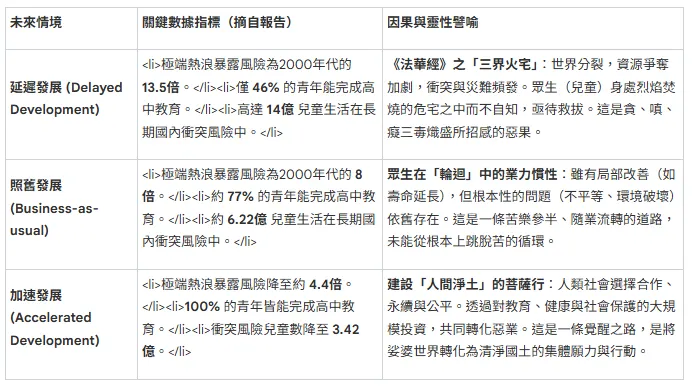

下表將這三種情境與佛法中的譬喻進行類比,以深化其倫理意涵:

人類此刻正站在這個因果的岔路口。我們的每一個政策、每一筆投資、每一次消費選擇,都在為兒童的未來投下一票——是選擇走向火宅,停留在輪迴,還是共同邁向淨土。

--------------------------------------------------------------------------------

第二部:心識之圍城——前沿科技的倫理風險深度剖析

2.1 唯識宗視角:人工智慧與數位阿賴耶識

本節將運用佛教唯識宗關於心識運作的深刻智慧,剖析人工智能(AI)對兒童心識結構與社會公平所构成的深層挑戰。唯識宗認為「萬法唯識」,一切外境皆是心識的變現。在數位時代,這一哲學觀點為我們理解AI提供了獨特的視角。

- 數位阿賴耶識 (Digital Ālaya-vijñāna):我們可以將互聯網、雲端與大數據,比喻為一個外化了的人類集體「阿賴耶識」(又稱藏識)。這個巨大的數位資料庫,儲存著人類無數行為、語言、思想乃至偏見的「種子」(bija)。AI系統正是在這片集體的心識之田中學習、成長。

- 染污的種子與現行 (Tainted Seeds and Manifestations):報告中明確警告,AI演算法可能存在偏見,例如面部識別技術對兒童和少數族裔的準確率較低。從唯識學來看,這正是因為我們餵養給AI的數據「種子」本身是染污的——它們來自一個充滿歷史性歧視與不平等的社會。當這些帶有偏見的「染污種子」被AI算法激活時,便會產生出歧視性的「惡業現行」(例如,在教育、招聘或司法系統中對邊緣群體兒童做出不公的判斷),從而系統性地複製並加劇了現實世界的不公。

- 數位鴻溝與無明 (The Digital Divide and Ignorance):報告指出,在低收入國家,高達九成的15-24歲女孩與年輕女性無法上網。這種巨大的「數位鴻溝」,可以被詮釋為一種結構性的「無明」(Avidyā)。當這些孩子被排除在人類集體的「數位阿賴耶識」之外時,她們不僅失去了學習與發展的機會,更在人類集體意識的流動與演化中被徹底邊緣化,其聲音、智慧與潛能的種子,也無從播入這片共業之田。

因此,僅僅進行技術層面的修補是遠遠不夠的。要實現真正的技術正義,我們必須從根源上著手,努力清淨AI賴以學習的數據「種子」,確保其能夠公正、平等地反映並服務於每一個孩子。

2.2 心理學視角:神經科技與認知自由之守護

本節將從發展心理學、健康心理學及人權心理學的整合視角,評估新興科技對兒童心理健康與認知主權(Cognitive Sovereignty)的潛在威脅。兒童的心靈並非縮小版的成人心靈,其獨特的發展階段使其在面對科技衝擊時,呈現出特殊的脆弱性。

我們識別出以下三大核心風險:

- 認知自由的侵犯:報告中提及的「神經科技」(Neurotechnology),如腦機介面等,雖在醫療領域前景廣闊,卻也打開了潘多拉的魔盒。這些技術可能被用於監控兒童的思想、分析其情緒反應,甚至進行潛意識層面的情感操縱。這直接挑戰了「認知自由」(Cognitive Liberty)與「精神完整性」(Mental Integrity)這兩項基本人權。守護兒童內心世界的私密性,防止其「心田」被未經許可的技術入侵、播撒成癮的種子或被數據開採,已成為這個時代最為迫切的倫理任務。

- 發展的脆弱性:發展心理學的洞見與佛教的智慧在此交匯。現代科學揭示,兒童與青少年時期是大腦前額葉皮層(負責決策、衝動控制)尚未發育成熟的關鍵階段,這正是佛法所言,生命早期的心識(mind-consciousness)最為柔軟、可塑。這種生理上的未成熟,加之其大腦高度的可塑性,使他們在面對社交媒體的成癮性設計與個人化內容的微妙操縱時,顯得格外易感。演算法利用多巴胺回饋機制,很容易在兒童身上形成行為成癮,這無異於在他人的心田中種下惡習的種子,剝奪了他們發展自主性與深度專注力的寶貴機會。

- 氣候焦慮與心理創傷:報告揭示了氣候危機對兒童的直接衝擊。科技,特別是社交媒體,在此扮演了放大器的角色。鋪天蓋地的災難影像與末日敘事,使兒童普遍產生「生態焦慮」(Eco-anxiety)、無助感與對未來的絕望。這種慢性的心理壓力,若無適當的疏導與賦能,將對整整一代人的心理健康造成深遠的創傷。

總而言之,在前沿科技的設計、部署與監管中,保護兒童的心理健康與認知主權,必須被置於與身體安全同等重要的位置。這已不再是倫理上的選項,而是我們不可推卸的責任。

2.3 法律與人權視角:在數位時代重申《兒童權利公約》

誕生於35年前的《兒童權利公約》(Convention on the Rights of the Child, CRC),是守護全球兒童福祉的基石。然而,前沿科技的飛速發展,正對其核心原則構成前所未有的挑戰。現有的法律框架,顯然已難以完全應對數位時代的複雜局面。

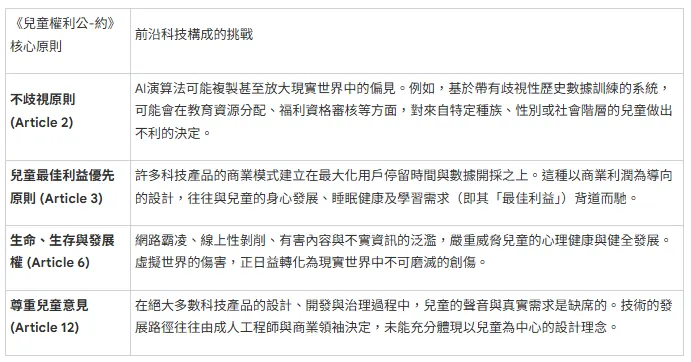

下表分析了科技風險如何衝擊CRC的四大核心原則:

面對這些挑戰,我們迫切需要對現有的法律框架進行更新與擴充,將數位權利明確納入兒童權利的保護範疇,確保《兒童權利公約》的精神在21世紀的數位土壤中,依然能夠落地生根,為每一個孩子提供堅實的庇護。

--------------------------------------------------------------------------------

第三部:人間淨土的路徑圖——倫理治理框架與法治建議

3.1 倫理治理的核心心法:四大指導原則

僅僅分析風險是不足的。我們必須從前文的深度剖析中,提煉出一套能夠指引未來行動的核心原則。這套原則融合了佛法的慈悲智慧、心理學的人本關懷與人權法的普世精神,旨在為科技治理提供一個堅實的倫理羅盤。

- 第一原則:以「兒童最佳利益」為最高菩提心 (The Primacy of Bodhicitta) 此原則確認,在任何涉及兒童的科技開發、應用與政策制定中,「兒童的最佳利益」必須是最高且不可妥協的考量。它應凌駕於商業利潤、技術創新乃至國家安全等一切其他利益之上。如同菩薩發起「上求佛道,下化眾生」的菩提心,這一原則是所有後續行動的根本動機與道德前提。任何可能損害兒童身心福祉的技術,無論其商業潛力多大,都應被視為不道德的。

- 第二原則:守護「心田」——認知自由與精神完整性 (Protecting the "Mind-Ground") 此原則旨在保護兒童最內在的心靈空間。我們倡導國際社會共同確立兒童的「神經權利」(Neurorights),並將其納入法律保護。應嚴格禁止任何以非醫療為目的、侵入性地監測、分析或修改兒童心智活動的技術應用。兒童的心靈是一片需要精心呵護的「心田」,我們有責任確保這片田地純淨、自主,不被算法的雜草所侵占。

- 第三原則:清淨「共業」——算法公平與透明 (Purifying "Collective Karma") 此原則直接回應AI偏見的問題。我們要求科技公司必須對其核心演算法進行定期的、獨立的偏見審計,並以通俗易懂的方式向公眾公開其運作邏輯與潛在風險,實現算法透明。更重要的是,必須投入資源,建立能夠真實反映全人類多樣性——特別是兒童與邊緣群體——的「清淨」數據集。這是在源頭上淨化集體「共業」,避免未來的AI系統成為固化不平等的工具。

- 第四原則:平等「帝網」——普惠的數位包容 (The Equal "Indra's Net") 此原則強調,彌合數位鴻溝不僅是經濟問題,更是一項全球性的道德責任。我們呼籲將「有意義的網路連接權」(Meaningful Connectivity)確立為一項基本人權。確保每一個孩子,特別是身處非洲和南亞等地區的女孩,都能平等、安全、且可負擔地接入數位世界,是構建一個公平的全球「帝網」的基礎。讓每一個節點都能發光,整張網絡才會璀璨光明。

3.2 具體法治與監管行動建議

為了將上述倫理原則轉化為具體的社會變革,我們提出以下四項可操作的法律與政策建議:

- 立法層面:強制推行「兒童權利影響評估」 我們建議推動強制性立法,要求所有面向兒童或可能對兒童產生重大影響的新技術、新產品或新服務,在正式上市前必須完成一份全面的「兒童權利影響評估」(CRIA)。此評估不僅是一項法律程序,更是將佛法中的「正見」(Right View)與「觀照」(Contemplative Observation)制度化的實踐——在行動之前,深刻地審視一項新技術可能帶來的深遠因果與業力影響。

- 監管層面:建立跨學科的「兒童科技倫理監管委員會」 各國應建立一個獨立的、超越現有部門劃分的監管機構。此委員會應如現代社會的「僧伽」(Sangha),作為一個由多元智慧組成的賢聖集體,其成員應涵蓋兒童心理學家、教育家、倫理學家、法律專家、數據科學家以及兒童與青年代表,共同為社會提供道德監督與集體智慧,並對違規企業施以具有足夠威懾力的重罰。

- 企業責任:倡導「兒童權利與福祉 by Design」開發模式 此模式旨在將佛法中「因果不虛」的法則,融入科技設計的源頭。它主張在「因」地——即技術的架構與核心邏輯中——就主動植入對兒童權利與福祉的保護,以期自然結出良善的「果」,而非在惡果顯現後再被動補救。這包括預設最高的隱私保護、關閉成癮性功能,以及在設計過程中邀請兒童參與,真正做到「為兒童設計,與兒童共創」。

- 國際合作:設立「全球兒童數位未來基金」 我們呼籲高收入國家與全球科技巨頭,共同出資設立一個專項基金,支持發展中國家,特別是非洲與南亞地區的數位基礎設施建設與數位素養教育。這不僅是技術援助,更應被視為一種對全球下一代的「佈施」(Dana),是富裕國度與科技巨頭清淨全球數位「共業」(Collective Karma)、為未來創造共享功德的必要之舉。

--------------------------------------------------------------------------------

結語:選擇慈悲,為2050年的孩子點一盞心燈

聯合國兒童基金會的報告,以冷靜的數據為我們揭示了一個溫暖的核心真理:未來並非命中注定。人類是走向一個因不平等、氣候災難與科技濫用而更加分裂、失衡的「火宅」,還是一個透過合作、智慧與遠見而共同建設的、永續的「淨土」,完全取決於我們當下的行動。

這份報告是對我們每一個人的召喚。它呼籲各國政府,將兒童的福祉置於所有議程的核心;它呼籲科技企業,以倫理與責任駕馭創新的力量;它更呼籲每一位成年人,承擔起作為守護者的神聖職責。或許,最動人的誓願,已由未來的佛子親口道出。正如報告中所引述的15歲少年阿里亞克桑德·皮亞特魯(Aliaksandr Piatrou)寫給未來世代的信中所承諾的:「作為你們的前輩,我深知我對你們美好的未來負有巨大的責任。我承諾將盡一切可能,讓你們能生活在一個幸福、萬里無雲的世界裡。」這聲聲誓言,正是人間菩薩行的真實展現。

讓我們選擇慈悲,選擇遠見,選擇合作。讓我們今日的每一個決定,都成為為2050年的孩子們點亮的一盞心燈,照亮他們前行的道路,也溫暖我們共同的未來。

南無阿彌陀佛,Assalamu Alaikum,God bless you,Om Shanti Shanti Shanti。