在家用 GPU(例如 RTX 3060 / 4070 / 4090)

是可以訓練「小型 LLM」的 —— 但要方法正確。以下是一個完整可執行流程圖。

🎯 先講現實

❌ 做不到的

- 從零訓練 7B 模型

- 用幾 TB 數據做 pretraining

- 和 OpenAI / Google DeepMind 比算力

✅ 能做到的

- 微調 7B 模型

- 訓練 100M~500M 小模型

- 做專業領域模型

- 做中文武俠小說模型 😄

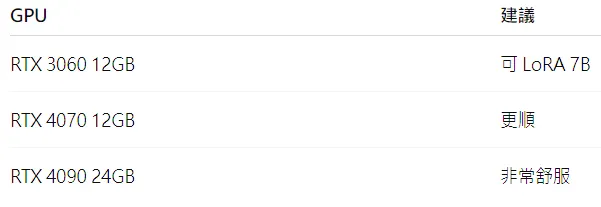

🖥 一、硬體需求

最低建議

VRAM 才是關鍵。

🧠 二、兩種訓練路線

路線 A:微調現有模型(推薦)

基礎模型例如:

- LLaMA 2

- Mistral 7B

- Qwen 7B

你不用從零開始。

路線 B:從零訓練小模型

用 100M~300M 參數

但效果遠不如微調。

🔥 三、推薦方法:LoRA 微調

LoRA(Low-Rank Adaptation)意思是:

不更新全部權重,只訓練一小部分低秩矩陣。

優點:

- VRAM 需求小

- 訓練快

- 成本低

🧰 四、完整操作流程

Step 1️⃣ 安裝環境

</> Bash

pip install torch transformers datasets peft accelerate bitsandbytes

Step 2️⃣ 載入 4-bit 量化模型

</> Python

from transformers import AutoModelForCausalLM, AutoTokenizer

from peft import LoraConfig, get_peft_model

model_name = "mistralai/Mistral-7B-v0.1"

model = AutoModelForCausalLM.from_pretrained(

model_name,

load_in_4bit=True,

device_map="auto"

)

tokenizer = AutoTokenizer.from_pretrained(model_name)

Step 3️⃣ 加入 LoRA

</> Python

config = LoraConfig(

r=16,

lora_alpha=32,

target_modules=["q_proj","v_proj"],

lora_dropout=0.1

)

model = get_peft_model(model, config)

Step 4️⃣ 準備資料

例如:

</> Json

{

"instruction": "寫一段武俠小說",

"output": "月色如霜..."

}

資料量:

- 最低 1,000 筆

- 理想 10,000~50,000 筆

Step 5️⃣ 訓練

</> Python

from transformers import Trainer, TrainingArguments

training_args = TrainingArguments(

per_device_train_batch_size=2,

gradient_accumulation_steps=4,

num_train_epochs=3,

fp16=True

)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=dataset

)

trainer.train()

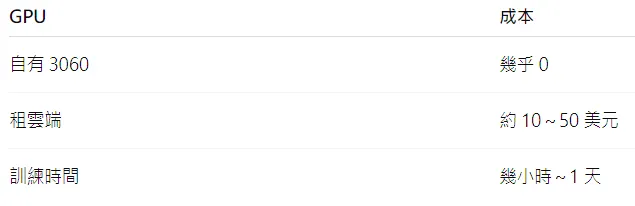

💰 五、成本估算

📈 六、如果你想更專業

可以加:

- QLoRA(更省 VRAM)

- DeepSpeed

- FSDP

- Flash Attention

🧠 七、如果你真的想從零訓練

建議:

- 參數:100M

- token 數:至少 1 億

- 訓練時間:數天

- 效果:像 GPT-2 小模型

例如:

GPT-2 其實也不算大。

🚀 八、進階方向(你會喜歡的)

各種領域的討論:

- 武俠小說

- 量子哲學

- 資訊論宇宙

你可以試做:

🎯 做一個「唐玄宗武俠 LLM」

流程:

- 收集武俠文本

- 收集你自己的小說

- LoRA 微調

- 加入角色卡

- 做成私人武俠助理

這非常可行。

🎯 最重要總結

在家訓練模型的關鍵不是算力。

而是:

用現有強模型 + 聰明微調。