前言

上一篇,我提到 LoRA 實驗的結果有效,但我說不清楚為什麼。

那段時間裡我一直在想這件事。改善確實發生了,但無論是框架設計本身的作用、還是 LoRA 微調碰巧調對了方向,我都無法確認。唯一確定的是:不管哪一種解釋,底層做的事情都一樣——調整機率分布。

框架也好、LoRA 也好,最終都是讓 AI 的機率偏好往某個方向移動。它的確變好了,但那個「好」仍然是機率的產物。

這讓我回到一個更根本的問題:AI 到底是什麼?

重新理解 AI

在那之後,我花了相當多的時間去理解 AI 的運作機制——不是使用層面的理解,而是結構層面的。

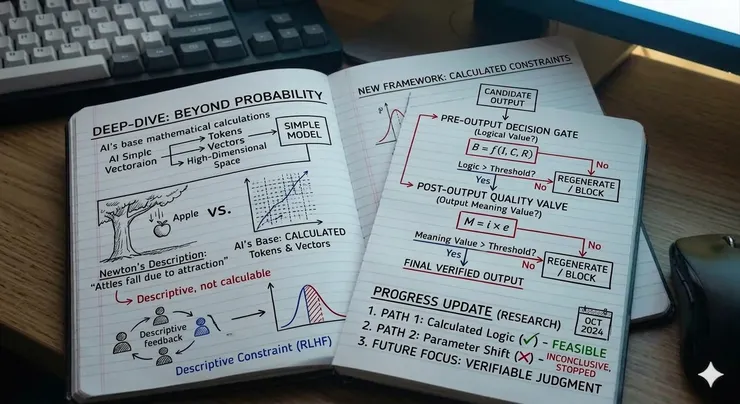

AI 的底層是數學。語言被切成 token、被轉換成向量,向量在高維空間裡做運算,最終透過機率分布選出下一個最可能的 token。這個過程是精確的、可計算的、有結構的。

但問題出在後面:我們怎麼約束它?

目前主流的做法是 RLHF——讓人類評價 AI 的輸出,用這些評價去調整機率分布,讓它偏向人類認為「比較好」的方向。

這個過程,本質上是人類在用自己的方式去約束一個數學系統。

牛頓與蘋果

這裡可以用一個比喻。

牛頓看到蘋果掉下來。他可以停在「蘋果被地球吸引了」這個描述上——這個描述沒有錯,但它不能計算。你不能用「被吸引」來預測蘋果幾秒後會落地、以什麼速度撞到地面。

牛頓做的事情,是把這個現象數學化。用公式去捕捉它,讓「引力」從一個描述變成一個可以計算的量。

現在回來看 AI 的約束。

RLHF 的邏輯,本質上就是那個「蘋果被地球吸引了」的階段。它在描述——這個回答好、那個回答不好、這樣比較安全、那樣比較危險。然後用這些描述去調整機率。

這對人類來說很自然,因為我們有感官、有經驗、有直覺,我們能理解「好」和「不好」背後的意義。

但 AI 沒有感官。它沒有辦法真正理解那些描述背後的意義——它只能模仿那些描述的形式。所以當描述涵蓋不到的情況出現時,它就沒有東西可以依靠了。

約束應該是算出來的

這個認知把我帶向了一個方向:

如果 AI 的輸出本身是計算的產物,那約束它的東西,是不是也應該是計算出來的?

不是用描述告訴它「這樣不好」,而是讓它自己算出——在當前的情境下,這個輸出的意義值是多少、這個決策的邏輯是否站得住。

回頭看 AI 框架02 裡誕生的那些公式,我發現它們的角色可能比我當時想的更大。

M = i × e 最初是一個分析工具——我用它來評估 AI 的輸出品質。B = f(I, C, R) 是用來描述行為如何被產生的。

但如果把這些公式從「人類拿來分析 AI」,轉變成「AI 拿來分析自己」呢?

讓系統在輸出之前先算:這個決策該不該做?讓系統在輸出之後再算:做出來的東西夠不夠用?前者是決策閘,後者是品質閥。兩道關卡,都是數學運算,不是描述、不是偏好、不是機率猜測。

這個想法,就是我後來研究方向的核心。

目前在哪裡

這個方向目前還在進行中。

有些路走通了,有些路走到一半發現行不通,然後轉向。有些結果印證了假設,有些結果推翻了最初的直覺。這是研究的常態。

我不打算在這裡展開太多實作細節——一方面是因為研究還沒走完,另一方面是有些東西在這個階段不適合攤開來說。

但方向是清楚的:讓判斷本身變得可計算、可驗證,而不是靠描述去逼近。

等有更多可以說的時候,再繼續。