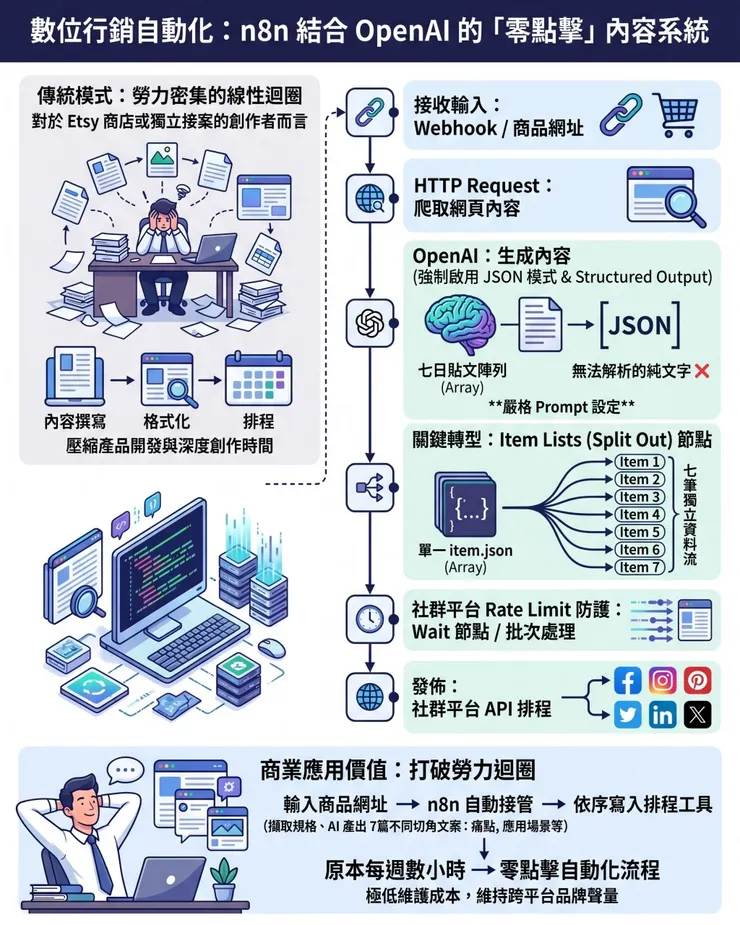

在自媒體與電商營運中,維持社群平台的活躍度是一項極度消耗線性勞力的工作。為了保持曝光,創作者必須每週耗費大量時間構思主題、撰寫文案並手動設定排程。為了解決這個痛點,近期社群中充斥著一種看似完美的解決方案:宣稱只需在 n8n 中輸入一個主題或網址,OpenAI 就會自動生成一週的貼文,並透過排程工具自動發布到各大平台。

## 內容農場的技術幻覺與全自動發布的痛點

在自媒體與電商營運中,維持社群平台的活躍度是一項極度消耗線性勞力的工作。為了保持曝光,創作者必須每週耗費大量時間構思主題、撰寫文案並手動設定排程。為了解決這個痛點,近期社群中充斥著一種看似完美的解決方案:宣稱只需在 n8n 中輸入一個主題或網址,OpenAI 就會自動生成一週的貼文,並透過排程工具自動發布到各大平台。

這種論述精準擊中了創作者的焦慮,但從防禦性系統審計的角度來看,這套「全自動發布系統」充滿了嚴重的技術幻覺。

最大的迷思在於對 AI 能力與 API 穩定性的過度信任。在真實的商業環境中,將未經審核的 AI 內容直接推送到正式環境,無異於將品牌聲譽交給機率決定。此外,缺乏對底層資料結構與錯誤處理機制的理解,將導致這類工作流在運行不到一週後,就因為各種不可控的外部因素而靜默崩潰。

## 底層運行機制與防禦性架構拆解

要將這個概念驗證(PoC)級別的流程轉化為具備商業價值的生產線,我們必須硬核拆解其資料流向,並修補其中的三個致命防禦性盲點。

第一是「網址讀取」的技術幻覺。許多人誤以為將網址字串傳遞給 OpenAI API,AI 就能自動讀取網頁內容。事實上,標準的 API 端點並不具備聯網爬蟲能力。如果你只傳遞網址,AI 會根據網址的英文字母進行「猜測」,產出充滿幻覺且毫無深度的罐頭內容。真正的防禦性做法,必須在 OpenAI 節點之前,前置 HTTP Request 節點去抓取目標網頁的 HTML,接著使用 HTML 解析節點(如 Cheerio)精準萃取內文與標題,再將這些乾淨的結構化資料送入 AI 的 Context Window 中。

第二是資料結構的衝突與陣列處理。當你要求 AI「生成一週的貼文」時,為了確保格式穩定,我們通常會強制 AI 輸出 JSON 格式。此時,AI 回傳的會是一個包含 7 筆資料的單一 JSON 陣列(Array)。然而,多數排程工具(如 Buffer API 或社群原生 API)的端點,每次只能接收「單一筆」貼文請求。如果你直接將整個陣列塞給 HTTP Request 節點,系統會因為 Payload 格式錯誤而直接拒絕請求。

在這裡,我們必須強制引入 Item Lists(或 Loop)節點。它的作用是將 AI 產出的單一陣列,拆解為 7 個獨立的執行項目(Items)。系統會進入迴圈,逐一將每一筆貼文的文案、圖片連結與預定發布時間,映射到排程 API 的對應欄位中,確保資料流的精準對接。

第三是 OAuth 憑證過期與靜默崩潰。社群平台的 API 授權通常具有嚴格的時效性。當 Token 過期,或者排程 API 發生 502 錯誤時,若 n8n 工作流未配置 Error Trigger 進行全局攔截,系統將直接靜默停止(Silent Failure)。你以為系統還在自動發文,實際上品牌已經空窗了整整一週。防禦性架構必須強制設定重試機制(Retry on Fail),並在 API 阻斷時透過 Webhook 發送 Slack 警報給管理員。

## 實務落地與商業槓桿

理解了底層限制後,我們就能重新設計一套真正具備商業槓桿的「人機協作(Human-in-the-loop)」工作流。

在實務應用上,我們絕對不追求 100% 的無人化發布,而是利用自動化打破「內容產出與格式轉換」的線性勞力迴圈。

具體的防禦性工作流程如下:創作者在 Notion 中貼上參考文章的網址與核心觀點。n8n 排程自動啟動,透過 HTTP 節點深度爬取網頁內容,交由 OpenAI 依據品牌語調生成 7 篇不同角度的社群貼文,並格式化為 JSON 陣列。

接著,工作流不會直接發布,而是將這 7 篇草稿傳送至 Slack,並進入 Wait 節點(等待人工介入)。創作者只需在手機上花費 3 分鐘審閱這些文案,確認無誤後點擊 Slack 上的「核准」按鈕。n8n 接收到 Webhook 回傳後,才會啟動 Loop 節點,將陣列拆解並逐一寫入 Buffer 排程系統。

這種架構將原本需要耗費數小時的文案撰寫與平台排程,降維成幾分鐘的決策審核。它不僅徹底規避了 AI 幻覺帶來的公關風險,更確保了系統在面對 API 異常時具備自我通報的能力。這才是自動化技術在內容生產中,最精準且具備防禦深度的落地方式。

👉『加入沙龍/訂閱電子報』,獲取更多技術解法。

[Note_Leon3D: recSRwI60mlMZInjW]