讓 AI 成為思考對手,磨利自己的判斷力

上一篇文章我談到,AI 讓答案來得太快,一份企劃初稿、一段分析文字、一個課程大綱,幾秒鐘內就能出現在眼前,而「太快有東西」這件事,可能讓我們在不假思索的情況下,漸漸把練習判斷的機會讓渡出去,必須警覺。下一個問題則是:有沒有想過你只是在和 AI 要答案,還是在和 AI 對練?

延伸閱讀: 當答案來得太快,我們越要保留思考的摩擦--別讓 AI 省掉了我們練習判斷的過程同樣用 AI,為什麼有人越用越敏銳?

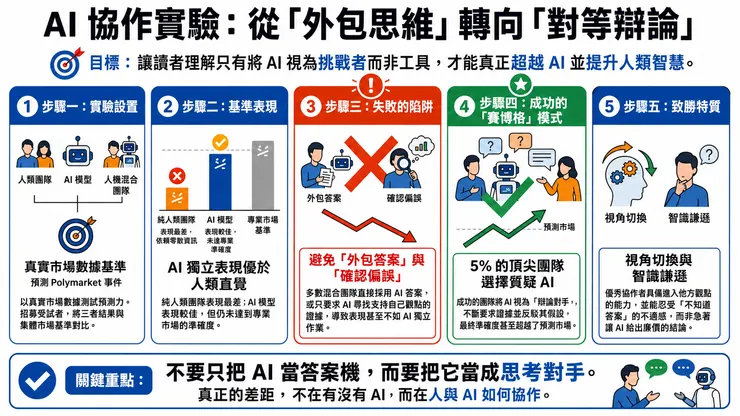

最近讀到一個讓我印象深刻的實驗:理論神經科學家與人工智慧專家 Vivienne Ming 與研究團隊在 2025 年招募了 72 位參與者,並將參與者隨機分派至三種類型的預測團隊:純人類團隊、純 AI 預測系統,以及由人類與 AI 助理共同構成的人機混合團隊。

每個團隊在一小時內,需對多項真實世界事件做出機率式預測,例如政治選舉、宏觀經濟指標或科技產業發展。研究者再將這些預測結果,與去中心化預測市場(一種透過交易合約價格來反映未來事件發生機率的制度)平台 Polymarket 上由數千名具財務動機的交易者所形成的市場價格,以及事件最終結果進行比較,以評估不同預測主體在準確性與校準程度上的差異。

這個實驗結果雖不足以直接推論到所有 AI 使用情境,但很適合用來觀察人機合作的品質,差異不在於有沒有使用 AI,而在於人與 AI 的協作方式。

三組中:純人類小組在資訊與時間有限的條件下表現較弱,純AI 組明顯更好,但仍不及市場整體。真正值得注意的,是人機混合組的差距之大。多數混合團隊的表現並不比 AI 單獨行動更好,原因很簡單——他們接受 AI 的答案後直接提交,等於只是借了 AI 的嘴說話。另一部分人的表現更差:他們先有了預設判斷,才請 AI 幫忙找理由補足證據,結果陷入確認偏誤的迴圈。

在這個實驗裡,只有約 5% 到 10% 的混合團隊,表現能持續與市場準確度競爭,某些問題的預測結果甚至贏過市場(勝過大盤)。原因在於,這些小組中,人把 AI 當成對練對手:他們不只是單純接受AI給的答案,而是要求 AI 提出反例、挑戰假設,以及在 AI 顯得過度自信時,反而追問它可能漏掉了什麼。

差異不在於有沒有使用 AI,而在於人與 AI 的協作方式

答案機、確認器、對練者:三種用法,三種結果

這個實驗讓我想到,大多數人用 AI 的方式,大概可以分成三個層次,產生的結果差距很大。

最常見的,是把 AI 當成答案機。有一個問題,打開對話框,幾秒鐘後得到一段結構完整、語氣篤定、看起來相當合理的回答,然後複製、修改、交出去。這種用法在資料整理、初步構思和例行文案上,的確很有效率。

但如果所有需要判斷的工作都這樣處理,我們很容易跳過中間那段需要自己拆問題、比較假設、想像反對意見的不舒服過程,安於「答案已經在眼前」的狀態裡。

比答案機更隱蔽的,是把 AI 當成確認器。這種情況通常發生在我們心裡已經有了一個判斷,只是想獲得支持,讓 AI 補理由、找證據、整理成更有說服力的說法,表面上好像是在善用 AI 協助論證,但如果使用者沒有刻意要求反方觀點,AI 很可能成為一個高效率的自我合理化工具。

舉個例子:主管已認定某個專案失敗是團隊執行力不足,問 AI「執行力不足可能造成哪些問題」,得到的是一份強化原有判斷的清單;但如果問「如果失敗不只是執行力問題,還可能有哪些原因?」,得到的就是完全不同的答案,討論的起點也跟著改變。

第三種,是把 AI 當成對練者。這時候不急著接受答案,而是讓它協助拆解判斷過程本身:檢查假設、模擬反方,或站在不同利害關係人的角度看同一件事。它有用,是因為它和你不同,不是因為它會同意你。這也是那 5% 到 10% 的混合團隊真正做到的事。

從單圈到雙圈:AI 何時真正進入管理者的判斷流程?

要理解以上三種人與AI協作方式的差異,可以借用管理學裡的一個框架。

哈佛大學教授克里斯・阿吉里斯(Chris Argyris)在研究組織學習時,提出了「單圈學習」(Single-Loop Learning)與「雙圈學習」(Double-Loop Learning)的區分。

在單圈學習中,行動邏輯大致是:設定目標 → 執行行動 → 發現偏差 → 調整作法以接近原目標。這種學習強調「把原來的事情做得更好」,例如調整流程、修改執行細節、加強控制與監督。

相對而言,雙圈學習的邏輯則是:在修正行為的同時,進一步思考「我們為何要追求這個目標?這樣的成功定義是否仍然合理?我們對環境與人性的假設是否過時或偏誤?」當行動連續受挫時,雙圈學習者不只檢討方法,更會重新檢視問題框架與設計本身。

簡單來說,單圈學習修正的是行動本身,雙圈學習檢視的是行動背後的目標、假設與判斷標準。

阿吉里斯:雙圈學習理論(Double-Loop Learning)

把這個框架套進 AI 的使用情境,若我們只是把 AI 當答案機或確認器,多半仍停留在單圈學習:幫我們把原本的路走得快一點、順一點,但問題框架沒有變,假設也沒有真正被檢驗。但把 AI 當對練者的人,才能達到雙圈學習的效果。

這個差異在日常工作裡很具體。同樣是想改善團隊會議效率,單圈的問法是:「如何讓會議更有效率?」AI 會提供議程設計、時間控制、會前準備等建議,這些都實用,但它們都在既有問題定義裡修正做法。雙圈的問法則往前一步:「如果會議效率差,其實不是設計問題,而是決策權責不清,可能出現哪些徵兆?」這個問題一出現,討論就不再只是改善會議,而是重新檢查組織運作的基本假設。

十輪問答,逼我重新定義問題

我在自己的工作裡,也常有運用 AI 讓我停下來重新想的經驗。

用最近的例子:我正在規劃一場三小時的演講,主題是「給繁忙工作者的讀書法」。以過去的習慣,可能會把大綱列出來請 AI 整理成完整的內容結構,一小時之內就有一份可以用的版本。但這次我換了一種方式,在對話框裡說:「請你不要直接給我規劃,而是跟我進行十輪討論,每輪你問我一個問題,我來回答。」

接下來的過程裏,AI 問我這場演講的目標受眾是誰,我給了一個以為很清楚的答案,然後它的下一個問題讓我卡住:「你描述的聽眾痛點是『看得懂但用不上』,但背後有三種不同的根因,你知道自己要解決哪一種嗎?」我沒辦法立刻回答,還花了一段時間釐清心裡的想法。十輪問答下來,我才發現,這場講座的主題核心不只是「怎麼讀得更有效率」,而是那些長期閱讀、整理筆記的中階工作者,為什麼在遇到真實的模糊問題時,仍然覺得學的東西用不上。

這個發現改變了整場講座的定位,定案的講綱並非 AI 直接幫我生成的,而是在與AI的來回追問裡慢慢浮現的。如此協作最有價值的地方,不是 AI 幫我整理了什麼,而是它逼我退回去重新檢視:我原本以為要解的問題,可能還不是真正重要的問題。

三個問題,讓 AI 從答案機變成思考對手

要把這個方向落進日常工作,我自己現在的習慣是,每次接受 AI 的答案之前,多問三個問題。

第一個問題:「請提出這個建議最強的反方論點。」這可以防止 AI 只順著我們的提問方向走,也讓我們有機會看到自己原本不想面對的反對理由,確認判斷真的想過了,而不只是借用了一份看起來合理的答案。

第二個問題:「這個答案依賴哪些前提?其中哪些最容易出錯?」這可以把看似完整的結論拆回假設層。AI 使用限定語氣的地方,例如「可能」、「這取決於」、「需要更多資訊才能判斷」,通常正是真正的不確定性所在,也是最不能外包的部分。

第三個問題:「如果我是另一個利害關係人,我會怎麼反對這個建議?」在管理決策、課程設計或提案溝通裡,很多失敗不是來自方案本身太差,而是低估了別人看問題的方式。這個問題可以把 AI 從單一答案生成器,轉成多視角的模擬器。

當答案越便宜,問題意識反而越珍貴

最後,我想回到文章一開始提到的實驗裡的一個觀察。

文章裡提到,資訊取得越容易,人類主動探索的活動反而可能跟著下滑。這符合我自己使用 AI 的感受:以前要寫一段分析,問題會在腦子裡經過一番苦思:走路時想、洗澡時想,這些看起來沒有效率的時間,其實是判斷力正在被打磨的過程;現在,初稿出現得越快,越容易跳過那些必須逼自己釐清的問題。

對組織來說,這個風險更不容易被看見,因為短期的數字可能都往好的方向走:文件變多、簡報變快、會議摘要更完整。但如果團隊慢慢失去自己定義問題、辨識矛盾、形成判斷的能力,產出的增加和能力的增長,可能是兩件不同的事。

當答案越便宜,問題意識反而越珍貴。下次打開 AI 輸入指令之前,也許可以先暫停,問自己:「如果我現在的判斷是錯的,最可能錯在哪裡?」接下來,你和 AI 的對話,可能就會和過去不太一樣。